Xem danh mục

Web Crawler là gì? Lập chỉ mục tìm kiếm là gì?

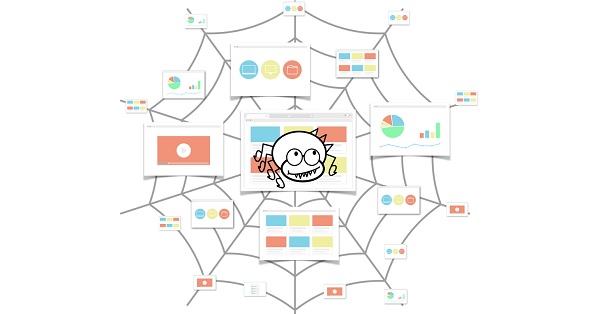

- Web Crawler, hay còn gọi là web spider, là một loại bot thường được vận hành bởi các công cụ tìm kiếm như Google và Bing.

- Mục đích của họ là lập chỉ mục nội dung của tất cả các trang web trên Internet để những trang web đó có thể xuất hiện trong kết quả của công cụ tìm kiếm. Cùng chuyennghiep.vn tìm hiểu nào.

Web Crawler là gì?

- Web Crawler dịch sang tiếng Việt là Trình thu thập thông tin web, là quá trình lập chỉ mục dữ liệu bằng cách sử dụng một chương trình hoặc tập lệnh tự động.

- Các tập lệnh này còn được gọi là web spider hoặc robot mạng. Trình thu thập dữ liệu web sao chép các trang để công cụ tìm kiếm xử lý, giúp người dùng tìm kiếm hiệu quả hơn bằng cách truy xuất thông tin cần thiết từ kho dữ liệu đã lập chỉ mục.

Lập chỉ mục tìm kiếm là gì?

- Lập chỉ mục tìm kiếm giống như tạo một danh mục thẻ thư viện cho Internet. Nó có thể được so sánh với mục lục ở phía sau một cuốn sách, liệt kê các vị trí chứa chủ đề cụ thể.

- Quá trình này tập trung vào văn bản và siêu dữ liệu (metadata) mà người dùng không thấy. Google sẽ thêm hầu hết từ ngữ vào chỉ mục (ngoại trừ các từ dừng như "a", "an", "the") để khi người dùng tìm kiếm, máy chủ sẽ chọn ra trang phù hợp nhất.

Trình thu thập dữ liệu web hoạt động như thế nào?

- Các bot bắt đầu từ một "hạt giống" hoặc danh sách URL đã biết. Khi thu thập dữ liệu, chúng tìm thấy các siêu liên kết mới và thêm chúng vào hàng đợi. Quá trình này diễn ra liên tục để cập nhật chỉ mục Internet khổng lồ.

Tầm quan trọng tương đối của mỗi trang web

- Bot không thu thập mọi trang web. Chúng ưu tiên dựa trên số lượng liên kết trỏ đến trang đó, lượng khách truy cập và độ thẩm quyền. Trang web được trích dẫn nhiều được coi là có thông tin chất lượng cao, tương tự việc thư viện giữ nhiều bản sao của một cuốn sách quý.

Xem lại các trang web & robots.txt

- Bot thường xuyên truy cập lại các trang để đảm bảo phiên bản mới nhất được cập nhật.

- Yêu cầu robots.txt: Trước khi thu thập dữ liệu, bot kiểm tra tệp robots.txt để biết quy tắc nào được phép và trang nào bị chặn (ví dụ quy tắc của Cloudflare).

Có nên luôn cho phép bot trình thu thập thông tin?

- Việc cho phép bot truy cập phụ thuộc vào tài nguyên máy chủ. Quá nhiều yêu cầu thu thập dữ liệu có thể làm hỏng máy chủ hoặc tăng chi phí băng thông.

- Các trang đích của chiến dịch Marketing hoặc trang kết quả tìm kiếm nội bộ thường được gắn thẻ "noindex" hoặc "disallow" trong robots.txt để tránh hiển thị không mong muốn trên Google.

Sự khác biệt giữa web crawling và web scraping

.jpeg)

- Web Scraping: Thường là tải nội dung trái phép cho mục đích xấu, nhắm mục tiêu cụ thể và thường bỏ qua áp lực máy chủ.

- Web Crawling: Tuân theo robots.txt, giới hạn yêu cầu và được thực hiện bởi các công cụ tìm kiếm lớn để phục vụ mục đích chung của người dùng.

Trình thu thập dữ liệu ảnh hưởng đến SEO như thế nào?

Nếu nhện bot không thu thập dữ liệu, trang web sẽ không thể được lập chỉ mục và hiển thị. Do đó, đừng bao giờ chặn các bot tốt nếu bạn muốn nhận lưu lượng truy cập tự nhiên.

Các bot phổ biến hiện nay:

- Googlebot (Desktop & Mobile)

- Bingbot

- Yandex Bot

- Baidu Spider

TƯ VẤN KỸ THUẬT SEO TOÀN DIỆN

Quản lý bot hiệu quả là chìa khóa để bảo vệ máy chủ và tối ưu hóa thứ hạng. Hãy để chuyên gia hỗ trợ bạn.

HỖ TRỢ TRỰC TIẾP QUA HOTLINE / ZALO

0357 339 779